こんにちは、ピリカ開発チームの九鬼です。

Docker Composeで複数コンテナからなるサービスを動かしている最中に、一部コンテナをアップデートしたいことがあります*1。

そこで、本記事ではその方法を紹介します(もし、さらに良い方法がありましたらぜひ伺いたいです)。

*1:例えば深層学習において、あるメンバーはTensorFlowで解析するサービス、あるメンバーはPyTorchで解析するサービスを作る、という構成が挙げられます

こんにちは、ピリカ開発チームの九鬼(niccari)です。

機械学習周りで物体検出したいとき、TensorFlowとともにObject Detection APIを利用することがあります。

Object Detection API側のアップデートで新規Docker環境が動かなくなったことがありました。

続きを読むこんにちは。 ピリカ開発チームの伊藤です。

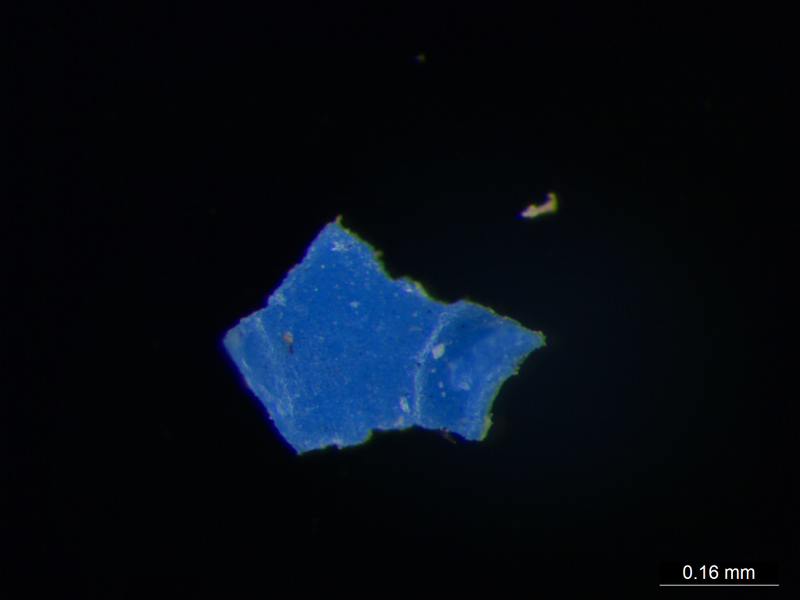

ピリカではアルバトロスプロジェクトで集めたマイクロプラスチックサンプルを分析する際、各サンプルの画像を撮っています。 このサンプル画像には、右下にスケールが書いてあり、この数字を元に映っているサンプルの最大径・面積などを求めています。

右下のスケールのテキストは顕微鏡のソフトウェアにより自動挿入されており、テキストデータとして得ることはできなかったため、別途このテキストを読み取る作業が必要ですが、1000を超すサンプルすべてに対してこれを人力でやるのは非効率です。 そこで、Cloud Vision APIを用いてこの右下のスケールを読み取るようにしました。

サンプル画像は分析作業の段階ではGoogleドライブに入っていますが、Cloud Vision APIで分析するにはhttp/httpsでアクセスできるようにするか、Google Cloud Storageにコピーする必要があります。

GoogleドライブからGoogle Cloud Storageへのコピーする際、一度ダウンロードしてからアップロードをすると時間がかかるだけでなく、一時ファイルに保存する必要があり面倒です。 なるべく手間なく高速にできればと思い、TypeScriptでストリーミングコピーを実装してみたのでご紹介します。

続きを読む